W ostatnich latach w Europie coś wyraźnie się zmienia. Administracje publiczne we Francji, w Niemczech i w Danii podjęły decyzję o odejściu od platform komercyjnych — np. wymieniając Windowsa na Linuxa. Wybierają otwarte formaty dokumentów i wybierają narzędzia, które mogą same hostować i kontrolować. Motywacja to mieszanka kosztów, suwerenności danych i rosnącej niechęci do tak silnego uzależnienia od garstki globalnych (tzn. amerykańskich) dostawców.

Prędzej czy później ta strategia dotrze do warstwy danych. Skoro system operacyjny, pakiet biurowy i format dokumentu są otwarte, to co z hurtownią, pipeline’ami i dashboardami, na które zarząd patrzy w każdy poniedziałek rano?

Jakie możliwości mamy w 2026 roku? Czy odejście od komercyjnych systemów wiodących dostawców to problem, czy może szansa? Jak wygląda ekosystem, który możemy zbudować w technologiach open-source? Na to pytanie postaramy się odpowiedzieć poniżej

Spis treści

Z czego składa się nowoczesny system BI

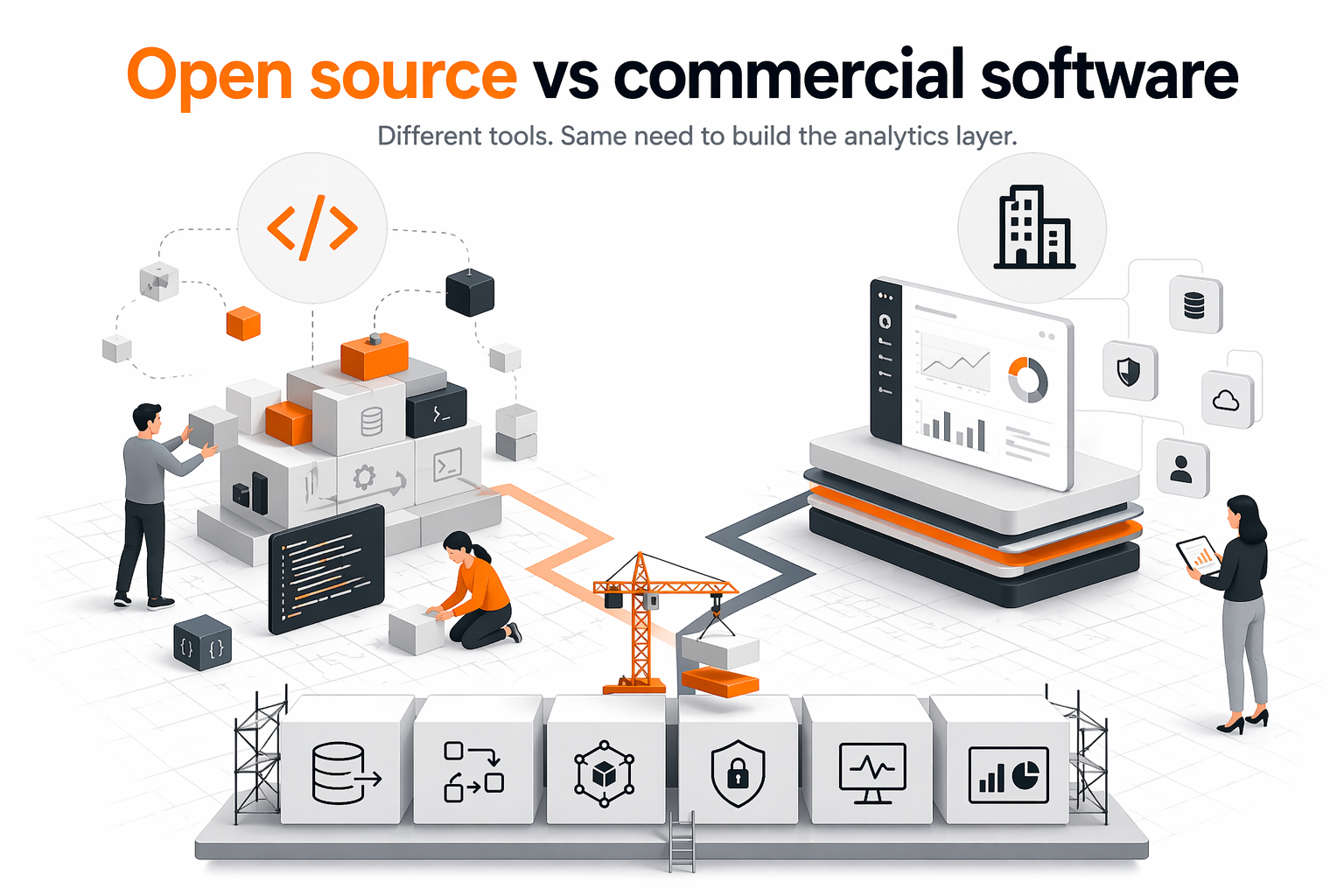

Żeby sensownie porównywać narzędzia, trzeba najpierw rozdzielić ich role. Inaczej bardzo łatwo wrzucić do jednej kategorii rzeczy, które są fundamentalnie różne.

Pierwszy obszar to przechowywanie danych i wykonywanie zapytań. Należą tu narzędzia takie jak PostgreSQL, ClickHouse, DuckDB czy Trino. Część z nich sprawdza się jako analityczne bazy danych, część lepiej nadaje się do lokalnej analizy, a inne pełnią rolę warstwy zapytań nad wieloma źródłami.

Drugi obszar to ekstrakcja i ładowanie danych ze źródeł. Po stronie open source ważnym punktem odniesienia jest Airbyte, po stronie usług zarządzanych — Fivetran.

Trzeci obszar to transformacja i modelowanie danych, czyli przekształcanie surowych tabel w coś wystarczająco stabilnego do spójnego raportowania. Tu liczą się przede wszystkim dbt i SQLMesh.

Czwarty obszar to orkiestracja, czyli planowanie i nadzorowanie zadań związanych z danymi. Klasycznym punktem odniesienia jest tutaj Apache Airflow.

Piąty obszar to raportowanie i samoobsługowe BI. Po stronie open source zespoły najczęściej rozważają Metabase, Apache Superset i Lightdash, po stronie komercyjnej punktami odniesienia są zazwyczaj Power BI, Tableau i Looker.

Dopiero po rozdzieleniu tych ról staje się jasne, że open source BI to nie jeden produkt. To zestaw osobnych decyzji, które trzeba podejmować warstwa po warstwie.

Co ma sens w każdym obszarze

Hurtownia danych, analityczna baza danych i warstwa zapytań

To fundament całego systemu. Decyzje podjęte w tym miejscu wpływają na wydajność zapytań, skalowalność i koszt dalszego rozwoju.

PostgreSQL pozostaje bardzo mocnym punktem wyjścia. Projekt ma za sobą prawie 40 lat aktywnego rozwoju, a oficjalna strona pokazuje bieżące aktualizacje dla obsługiwanych wersji również w 2026 roku. W przypadku małych i średnich obciążeń analitycznych PostgreSQL może być całkowicie wystarczający, zwłaszcza jeśli zespół już go dobrze zna.

ClickHouse to kolumnowa baza danych zaprojektowana do analityki OLAP. Dobrze sprawdza się, gdy wolumeny danych rosną, a zapytania stają się cięższe. Oferuje wysoką wydajność, ale zazwyczaj wymaga bardziej przemyślanego podejścia do modelowania i operacji niż usługi zarządzane.

DuckDB świetnie sprawdza się do lokalnej analizy, przepływów pracy opartych na plikach i szybkiego prototypowania. Warto jednak pamiętać o ograniczeniach współbieżności opisanych w dokumentacji: jeden proces może czytać i zapisywać do bazy, wiele procesów może czytać, ale wtedy żaden nie może pisać, a wielu autorów zapisu jest obsługiwanych tylko w ramach jednego procesu piszącego. To czyni DuckDB świetnym narzędziem dla analityka, ale nie naturalnym wyborem dla centralnej bazy dzielonej przez wiele osób jednocześnie.

Trino pełni inną funkcję niż klasyczna hurtownia. To rozproszony silnik zapytań SQL, który pozwala organizacjom odpytywać dane tam, gdzie już się znajdują. Ma sens, gdy dane są rozproszone po wielu systemach, a firma chce wspólnej warstwy dostępu bez przenoszenia wszystkiego w jedno miejsce.

Po stronie komercyjnej głównymi punktami odniesienia są Snowflake i BigQuery. Ich zaletą jest wygoda: utrzymanie, aktualizacje i duża część strojenia pozostają po stronie dostawcy. Ceną za tę wygodę jest mniejsza kontrola architektoniczna i głębsze uzależnienie od modelu usługowego.

Wniosek jest prosty: open source ma sens w tym obszarze, gdy firma naprawdę potrzebuje większej kontroli lub ma wymagania, których wygodna usługa zarządzana nie jest w stanie rozsądnie spełnić. Jeśli priorytetem jest szybkie wdrożenie i niskie nakłady operacyjne, model zarządzany jest często lepszym wyborem.

Ekstrakcja i ładowanie danych

W praktyce ten obszar dotyczy tego, jak dane trafiają do hurtowni i ile pracy wymaga utrzymanie połączeń ze źródłami.

Airbyte oferuje ponad 600 gotowych konektorów, a Airbyte Core można wdrożyć jako system samodzielnie zarządzany. Dla wielu zespołów jest to atrakcyjne, bo daje większą kontrolę nad przepływem danych bez konieczności budowania wszystkiego od zera.

Istotne jest również to, że Airbyte Enterprise Flex oddziela warstwę zarządzania od części faktycznie przenoszącej dane w infrastrukturze klienta. W wdrożeniach wieloregionalnych obszary robocze można przypisać do konkretnych regionów, a dokumentacja wyraźnie stwierdza, że dane w takim obszarze roboczym są przenoszone wyłącznie przez przypisane środowisko przetwarzania. To realny argument dla organizacji potrzebujących ścisłej kontroli nad tym, gdzie dane są przetwarzane.

Jednocześnie ten wybór nie eliminuje pracy operacyjnej. Kto samodzielnie hostuje taki system, bierze na siebie odpowiedzialność za monitoring, aktualizacje, awarie konektorów i utrzymanie środowiska. Tu ujawnia się główna zasada open source BI: więcej kontroli zazwyczaj oznacza więcej codziennej odpowiedzialności.

Transformacja i modelowanie danych

To obszar, który często decyduje o rzeczywistej jakości analityki. Bez niego firma zazwyczaj kończy z nieuporządkowanym zbiorem tabel i zapytań SQL. Z nim może mieć spójne definicje metryk, testy jakości i logiczny model danych.

Głównym punktem odniesienia jest tu dbt. Jego dokumentacja podkreśla, że wprowadza praktyki inżynierii oprogramowania do pracy analitycznej: kontrolę wersji, testowanie, modułowość, CI/CD i dokumentację. Dokumentacja instalacyjna wyraźnie stwierdza też, że dbt Core pozostaje projektem open source na licencji Apache 2.0.

SQLMesh idzie w podobnym kierunku, ale kładzie większy nacisk na planowanie zmian i analizę ich wpływu przed wykonaniem. Dla niektórych zespołów może to być bardzo sensowna alternatywa.

To również jeden z obszarów, gdzie open source sprawdza się wyjątkowo dobrze. Można zbudować dojrzałą warstwę transformacji bez kupowania pełnej platformy komercyjnej — o ile zespół pracuje z dyscypliną wymaganą przez kod, testy i procesy wdrożeniowe.

Orkiestracja

Apache Airflow to otwarta platforma do planowania, uruchamiania i monitorowania wsadowych przepływów pracy. Przepływy definiuje się w Pythonie, a interfejs webowy pomaga zespołom śledzić zależności i diagnozować problemy.

Na papierze brzmi to prosto. W praktyce nadal trzeba obsługiwać scheduler, bazę metadanych, workery i resztę otaczającej infrastruktury produkcyjnej. Dlatego Airflow pasuje organizacjom, które chcą mieć tę kontrolę we własnych rękach lub już dysponują zespołem zdolnym do obsługi takiej platformy. Jeśli nie — zarządzane warianty tego typu rozwiązania są często rozsądniejszą opcją.

Raportowanie i samoobsługowe BI

To obszar najbardziej widoczny dla użytkowników końcowych, a jednocześnie ten, gdzie różnica między narzędziami open source a komercyjnymi jest często najbardziej odczuwalna.

Metabase Open Source można uruchomić jako oficjalny obraz Docker lub samodzielny plik JAR. Stosunkowo łatwo zacząć. Jednak dokumentacja dotycząca self-hostingu Metabase wymienia też komponenty potrzebne do produkcyjnego działania: serwery wysokiej dostępności, load balancer, bazę danych aplikacji, SMTP, kopie zapasowe, monitoring i certyfikaty SSL. Pokazane tam koszty infrastruktury zaczynają się od około 112–132 dolarów miesięcznie, zanim doliczy się czas zespołu.

Apache Superset oferuje większą elastyczność i szerokie możliwości eksploracji danych, ale quickstart Supersetu wyraźnie zaznacza, że Docker Compose jest przeznaczony do szybkiego startu oraz środowisk sandbox i deweloperskich — nie jest zalecany do produkcji. Dokumentacja produkcyjna wskazuje dalej na wdrożenia oparte na Kubernetes.

Lightdash jest szczególnie interesujący dla organizacji intensywnie pracujących z dbt. Jednocześnie dokumentacja Lightdash jest równie jasna: bezpieczny self-hosting produkcyjny wymaga solidnej wiedzy z zakresu Dockera, Kubernetes i bezpieczeństwa, a dla większości zespołów zalecaną ścieżką jest wersja chmurowa.

Po stronie komercyjnej Power BI, Tableau i Looker nadal mają przewagę tam, gdzie liczy się wygoda użytkownika, dojrzałość produktu i szerokie wsparcie dla większych grup biznesowych. Dlatego raportowanie to obszar, gdzie warto bardzo dokładnie policzyć, czy self-hosting naprawdę się opłaca.

Co open source naprawdę daje, a co tylko obiecuje

Najsilniejszym argumentem za open source nadal jest kontrola. Firma może wybrać własną infrastrukturę, precyzyjniej rozumieć granice rozwiązania i unikać przyjmowania pełnej logiki jednego dostawcy. W niektórych obszarach — szczególnie w transformacji danych i orkiestracji — to bardzo realna zaleta

Drugi argument to mniejsze ryzyko uwięzienia w jednym ekosystemie. Ale tu uproszczenia stają się niebezpieczne. Rynek open source BI w 2026 roku często działa w modelu mieszanym: otwarte edycje istnieją obok płatnych wersji, usług chmurowych lub warstw zarządzania obsługiwanych przez dostawcę. To nie przekreśla zalet open source, ale pokazuje, że „brak lock-inu” nie jest stanem zero-jedynkowym.

Trzeci argument to koszt. I tu najłatwiej o uproszczenia. Brak opłaty licencyjnej nie oznacza automatycznie niższego całkowitego kosztu. Jeśli firma samodzielnie obsługuje analityczną bazę danych, integracje, monitoring, kopie zapasowe, aktualizacje i środowiska wysokiej dostępności, koszt wraca w innej formie: czasu zespołu, infrastruktury i większej złożoności operacyjnej.

Czwarty argument to elastyczność. To prawda — ale tylko wtedy, gdy organizacja ma realny powód, żeby z niej korzystać. Jeśli potrzeby są standardowe, a zespół mały, bardzo elastyczna konfiguracja może okazać się po prostu droższym sposobem na osiągnięcie tego samego rezultatu.

Bezpieczeństwo, suwerenność danych, koszt i AI

Bezpieczeństwo

Self-hosting może zapewnić większą kontrolę nad siecią, politykami dostępu i miejscem przetwarzania danych. Ale nie sprawia automatycznie, że system jest bezpieczniejszy. Tę zaletę nadal trzeba realizować operacyjnie — przez szybkie łatanie luk, monitoring, kopie zapasowe, kontrolę zmian i reagowanie na incydenty.

Innymi słowy: open source może zwiększyć kontrolę nad bezpieczeństwem, ale nie zdejmuje odpowiedzialności za bezpieczeństwo. W wielu organizacjach to właśnie ta granica oddziela dobry pomysł od kosztownej iluzji.

Suwerenność danych

To kolejny obszar, gdzie proste hasła nie pomagają. Przechowywanie danych w Europie lub we własnej infrastrukturze samo w sobie nie rozstrzyga kwestii suwerenności. Trzeba rozróżnić co najmniej kilka rzeczy: gdzie odbywa się przetwarzanie, jak zorganizowane jest zarządzanie, jaki dostęp ma dostawca, jak wygląda relacja umowna i czy dochodzi do międzynarodowych transferów danych.

Dlatego narzędzia takie jak Airbyte mogą realnie pomagać w kontroli nad miejscem przetwarzania danych, ale same w sobie nie tworzą uniwersalnej odpowiedzi prawnej. Jeśli problem dotyczy transferów danych do państw trzecich, punktem odniesienia pozostają Zalecenia EROD 01/2020. Mocniejsze wnioski wymagają analizy prawnej, a nie tylko stwierdzenia technologicznego.

Koszt

Najbardziej uczciwa odpowiedź brzmi: to zależy od rodzaju organizacji. Open source może obniżyć koszty licencji i oferować większą elastyczność. Jednak pełny obraz obejmuje też wdrożenie, utrzymanie, kompetencje z zakresu DevOps i inżynierii danych, monitoring, wsparcie oraz czas potrzebny na reagowanie na problemy.

Dla firmy z dojrzałym zespołem technicznym i konkretnymi wymaganiami ten model może być bardzo opłacalny. Dla mniejszej organizacji, która po prostu chce sprawnie raportować dane bez budowania własnej platformy, koszty operacyjne mogą szybko przewyższyć pozorne oszczędności.

AI

AI realnie pomaga przy pracy wykonawczej: pisaniu SQL, kodu pomocniczego, testów, dokumentacji czy diagnozowaniu prostszych problemów. Nie ma jednak podstaw, by zamieniać to w uniwersalną obietnicę szybszego dostarczania BI od końca do końca.

Dowody są niejednoznaczne. Badanie dotyczące GitHub Copilot wykazało przyspieszenie o 55,8% w zadaniu skupionym na implementacji prostego serwera HTTP w JavaScripcie. Z kolei badanie METR przeprowadzone na doświadczonych programistach open source dało odwrotny wynik: średnio praca trwała o 19% dłużej, gdy dopuszczono narzędzia AI.

Praktyczny wniosek dla BI jest prosty. AI może przyspieszyć część pracy o charakterze wykonawczym, ale nie zastępuje decyzji dotyczących modelu danych, definicji metryk, jakości danych, odpowiedzialności operacyjnej ani architektury bezpieczeństwa.

Kiedy open source BI ma sens

Open source BI ma sens, gdy organizacja wyraźnie rozumie, dlaczego chce przejąć kontrolę nad konkretną częścią platformy danych.

Najczęściej to sensowna ścieżka, gdy firma:

- ma lub buduje zespół zdolny do obsługi systemów produkcyjnych,

- naprawdę potrzebuje większej kontroli nad architekturą, integracjami lub miejscem przetwarzania danych,

- świadomie akceptuje dodatkową odpowiedzialność operacyjną,

- chce unikać pełnego uzależnienia od ekosystemu jednego dostawcy.

Model bardziej zarządzany sprawdza się zazwyczaj lepiej, gdy:

- zespół jest mały i nie chce budować własnej platformy danych,

- szybkie uruchomienie i przewidywalne utrzymanie są najważniejsze,

- wygoda użytkowników biznesowych jest priorytetem,

- koszt self-hostingu nie przynosi proporcjonalnych korzyści.

W praktyce najlepsze rezultaty daje często podejście mieszane. Część firm wybiera open source tam, gdzie przynosi największą realną korzyść — na przykład w transformacji lub orkiestracji. Jednocześnie zachowuje bardziej zarządzane rozwiązania tam, gdzie samodzielna obsługa byłaby zbyt kosztowna lub po prostu zbędna.

Na koniec warto zadać kilka prostych pytań:

- Które części naszej platformy danych są naprawdę strategiczne?

- Gdzie potrzebujemy większej kontroli, a gdzie wystarczy niezawodna usługa?

- Czy mamy kompetencje, żeby obsługiwać tę konfigurację bez utraty jakości lub bezpieczeństwa?Do we have the skills to operate this setup without losing quality or security?

- Gdzie open source naprawdę obniży koszty lub lepiej dopasuje się do naszych potrzeb?

- Które zadania AI może dziś sensownie przyspieszyć, a których jeszcze nie powinniśmy oddawać automatyzacji?

Jeśli organizacja potrafi uczciwie odpowiedzieć na te pytania, open source BI przestaje być trendem albo światopoglądem. Staje się rozsądną decyzją projektową.